손정의 일본 소프트뱅크 그룹 회장은 문재인 대통령을 예방한 자리에서 “앞으로 한국이 집중해야 할 것은 첫째도 인공지능, 둘째도 인공지능, 셋째도 인공지능”이라며 교육·정책·투자·예산 등 각 분야에서 전폭적인 AI 육성책을 마련해야 한다고 조언했다. 또한 “AI가 인류역사상 최대 수준의 혁명을 불러올 것”이란 전망도 내놨다(한국경제, 2019.07.04).

손정의 회장이 인공지능을 세 번이나 강조한 이유는 무엇일까? 인공지능은 과거에도 주목을 받은 적이 있지만 크게 성공하지는 못했다. 하지만 최근에 벌어지고 있는 인공지능의 발전은 과거와는 확실히 다르다. 인공지능의 과거, 현재, 미래에 대해서 정리해본다.

AI의 과거

인공지능(AI, Artificial Intelligence)이라는 용어는 1955년 컴퓨터 과학자 존 매카시(John McCarthy)가 처음 사용했다. 뉴럴 네트워크(Neural Network), 처치-튜링 명제(Church-Turing Thesis) 등 관련 이론들은 그에 앞선 1940년대부터 등장하기 시작했다.

인공지능의 아버지로 불리는 앨런 튜링(Alan Turing)은 1950년 ‘Computing Machinery and Intelligence’ 논문에서 AI의 개념을 소개하기도 했다. 앨런 튜링은 현대 컴퓨터의 원형을 제시한 인물로 알려져 있다. 그는 최초의 컴퓨터라고 평가받는 ENIAC이 등장하기 이전(1936년)에 '튜링 머신'이라는 가상의 컴퓨터를 제시했다. 이 튜링 머신이 현대 컴퓨터의 원형이다. 최초의 전자식 컴퓨터가 나오기 전에, 가상으로 컴퓨터라는 기계를 상상하던 시점부터 앨런 튜링은 인공지능을 생각했던 것이다.

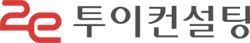

[그림 1] AI의 역사 / 출처: AWS, Saltlux

1950년대 이후 AI에 관한 연구가 본격화되면서 많은 관심을 받았지만 별다른 성과를 보여주지는 못했다. 1969년 마빈 민스키(Marvin Minsky) 박사가 인공신경망(Artificial Neural Network)의 한계를 수학적으로 증명하면서 AI 연구에 대한 투자와 관심이 급격히 감소했다.

이후 1980년대 폴 웨어보스(Paul Werbos), 제프리 힌튼(Geoffrey Hinton) 교수가 역전파(Backpropagation)를 이용해 MLP 문제를 해결하면서 인공신경망에 대한 연구가 다시 활발히 진행되다가 역전파가 소수의 신경망에서만 작동 가능하다는 한계를 맞이하며 다시 겨울을 맞이했다.

2000년 중반 제프리 힌튼, 요슈아 벤지오 등 세계적 석학들이 딥러닝(Deep Learning) 방법론을 제시하면서 AI는 새로운 국면을 맞이했고 2010년대 들어 컴퓨팅 성능 향상과 데이터의 양적 증가, 알고리즘 개선 등으로 머신러닝, 딥러닝이 구현되면서 다시 AI가 주목받고 있다.

과거의 시도에도 불구하고 지속적으로 발전하지 못한 이유는, 하드웨어, 소프트웨어, 데이터의 3박자를 만족하지 못했기 때문이다. 하지만 하드웨어 성능향상, 분산처리, 클라우드 환경, 머신러닝(Machine Learning), 딥러닝(Deep Learning), 역전파(Back Propagation) 등 알고리즘이 발전하면서 인공지능 성능이 높아졌다. 또한 빅데이터 시대로 오며 데이터의 절대적인 양과 다양성이 확대되면서 현재의 AI로 넘어오게 된다.

AI의 현재

AI 하드웨어 부문 발전은 반도체를 중심으로 전개되는데, 반도체는 데이터 저장을 위한 메모리 반도체와 논리적 연산을 수행하는 비메모리 반도체(시스템 반도체, Logic Chip)로 나뉜다. AI 하드웨어 부문에서 언급하는 반도체는 비메모리 반도체를 의미한다.

AI 반도체는 시장 초기에 데이터센터 서버에서 주로 사용되다가 점차 엣지 디바이스용(edge device)으로, 학습용에서 추론용으로 비중 변화를 진행하고 있다. 엣지 디바이스용으로 전환한다는 의미는, 가장자리(엣지)라고 할 수 있는 디바이스 자체에서 AI가 실행되는 환경으로 변한다는 의미이다.

[그림 2] AI 반도체 사용환경 / 출처: KISTEP

예를 들면 자율주행차의 경우, 제동/가속에 대한 의사결정이 최대한 빠른 시간에 이루어져야 하고, 이를 위해서는 데이터가 클라우드를 통하지 않고 엣지 디바이스에서 분석되어야 한다. 즉, 학습 과정 이후 추론 과정에서는 상대적으로 적은 데이터를 처리하지만, 보다 신속하게 응답을 수행해야 한다. 이로 인해 신속한 추론(신속성, 응답성)을 위한 최선의 환경을 위해 엣지 컴퓨팅이 선호된다.

소프트웨어의 경우, 2006년 인간의 뇌 신경망을 모방한 딥러닝(Deep Learning)이 등장하면서 AI의 성능과 정확도가 급격히 향상되었고 인간의 개입도 줄어들었다. 이미지 인식, 언어 인식 부문에서는 이미 딥러닝을 이용한 AI가 인간보다 뛰어난 수준으로 발전했다.

[그림 3] 주요 딥러닝 오픈소스 라이브러리

구글, 마이크로소프트 등 글로벌 IT기업들은 딥러닝 솔루션을 구축할 수 있는 프레임워크를 오픈 소스로 공개해 누구나 이들의 툴을 이용해 AI 모델을 만들 수 있다. 이를 넘어 구글, 아마존, 마이크로소프트, IBM은 오픈 소스 라이브러리를 넘어서 자동으로 머신러닝 모델을 만들어주는 서비스를 제공한다.

예를 들어, 구글 클라우드의 AI 솔루션 오토 머신러닝(Auto ML)은 AI가 머신러닝 모델을 만드는데 필요한 조건을 자동으로 조정한다. ‘데이터 수집 – 분석 – 학습 – 모델링 – 검증’ 단계에서 가장 오래 걸리는 모델링 영역을 생성해준다는 데 있어 전문지식과 전문인력이 부족한 기업에서 활용할 수 있는 단계까지 온 것이다.

데이터의 폭발적 증가 또한 AI 학습에 기여했다. 통신, 의료, 미디어, 제조 등 모든 산업에서 지난 2년간 생성된 데이터의 양이 인류 역사에서 만들어진 데이터양보다 크다. 이는 AI 알고리즘의 학습을 용이하게 했으며, 딥러닝 등 혁신적 기술의 상용화를 가능케 했다. 데이터 분야는 수집/저장, 분석/활용, 중개/처분 등에 대한 규제와 진입장벽 영향이 큰 편으로, 특히, 한국은 이 부분에 대한 해결이 반드시 선행되어야 한다.

AI의 미래

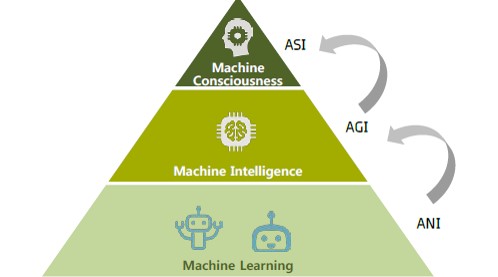

[그림 4] AI의 진화단계 / 출처: Wakefly

AI의 진화 중 훈련 받은 ANI(약 인공지능, Artificial Narrow Intelligence)는 특정 문제만 잘 수행하는 수준이라면, AGI(강 인공지능, Artificial General Intelligence)는 인간이 수행 가능한 대부분의 지적인 업무를 인간보다 훨씬 빠른 속도로 이해하고 학습한다.

AI가 인간의 지적 능력을 초월하기 시작하는 시점을 ‘특이점(Singularity)’이라고 부르는데, 일단 특이점에 도달하면 AI는 인간 이성의 한계를 빠르게 넘어서 스스로 발전하고 창조하는 지능 폭발(Intelligence Explosion)의 단계에 이르게 된다. 이러한 AI 단계를 ASI(초 인공지능, Artificial Super Intelligence)이라고 한다.

현재 대부분의 AI 관련 연구와 기술은 특정 문제 해결을 위한 약인공지능에 해당한다. 인공지능이 다음 수준으로 발전하면 경제, 사회, 문화 전반에 걸쳐서 큰 변화를 불러일으킬 것이다. 또한 인공지능을 사회의 한 구성요소로 받아들이기 위한 법률 및 제도의 준비도 뒷받침되어야 할 것이다. 확실한 것은 인공지능의 발전은 이미 시위를 떠난 화살이 되어 있고, 변화에 대한 준비는 지금 시작해야 한다는 점이다.

- 끝 -

* ‘인공지능 시대, 어떻게 준비해야 할까? [2부] - AI로 발생하는 사회변화와 기업의 대응 전략’으로 이어집니다